Apprentissage avec EarSketch

Jason Freeman, Brian Magerko, Doug Edwards, Morgan Miller, Shelly Engelman, Roxanne Moore, Anna Xambó et Tom McKlin juillet 2018

juillet 2018DOI : https://dx.doi.org/10.56698/rfim.458

Résumés

Résumé

Ce texte décrit EarSketch, un dispositif pédagogique combinant la musique et l’informatique pour créer une expérience d’apprentissage authentique qui mobilise des populations étudiantes diverses, facilite l’accès à la formation en technologie musicale et encourage la création musicale avec la technologie. Nous décrivons l’utilisation d’EarSketch à la fois dans des salles de classe avec des adolescents et dans des cours en ligne massifs et ouverts et nous comparons l’engagement des étudiants dans ces deux contextes d’apprentissage.

Abstract

This chapter describes EarSketch, a learning intervention that combines music and computer science to create an authentic learning experience that engages diverse student populations, increases access to music technology education, and evangelizes music making with technology. The use of EarSketch in classrooms with teenage students and in massive open online courses is described, and student engagement across these two learning contexts is compared.

Index

Index de mots-clés : informatique, musique, STEAM, MOOC, composition algorithmique, développement de l’informatique musicale, authenticité.Index by keyword : STEAM, MOOC, algorithmic composition, computer science, broadening participation, music, authenticity.

Notes de l'auteur

Une partie du matériel de ce texte est adaptée du texte publié dans Freeman et al. (2016).

Le projet EarSketch a bénéficié d’une aide de la National Science Foundation (CNS #1138469, DRL #1417835 et DUE #1504293), la Scott Hudgens Family Foundation, la Arthur M. Blank Family Foundation et la Google Inc. Fund of Tides Foundation. EarSketch est disponible en ligne sur http://earsketch.gatech.edu.

Texte intégral

1. Introduction

1EarSketch est un dispositif d’apprentissage de type STEAM (Maeda, 2013)1 qui combine un environnement de programmation et une API pour Python et JavaScript, une station de travail audio numérique, une bibliothèque de boucles audio et un programme d’étude normalisé pour enseigner l’initiation à l’informatique, en liaison avec les technologies musicales et la composition. La création d’EarSketch a été justifiée par trois motivations principales : élargir la communauté informatique, faciliter l’accès à l’enseignement des technologies pour la musique et inciter à produire de la musique avec la technologie.

1.1. Élargir la communauté informatique

2Bien que l’informatique soit omniprésente dans la société contemporaine, seul un petit pourcentage d’étudiants apprend la programmation, les sciences de l’informatique et la pensée informatique. Change the Equation résume cette contradiction en notant que 83 % des enfants du millénaire « disent dormir avec leurs smartphones », mais seulement 58 % d’entre eux « ont de faibles compétences dans la résolution de problèmes technologiques » (Change the Equation, 2015). Ce manque généralisé de compétences informatiques dépend de facteurs à la fois économiques et culturels. Il y a une demande croissante pour des emplois en informatique sur le marché du travail (Code.org, 2016). De façon tout aussi importante, l’informatique devient une compétence essentielle du xxie siècle : la compréhension des algorithmes cachés derrière les ordinateurs et de la façon d’écrire du code est essentielle pour comprendre les avantages des nouvelles technologies numériques, repousser leurs limites et exploiter leur potentiel créatif (Wing, 2006).

3L’enseignement de l’informatique ne doit pas seulement accroître la participation à de telles activités d’apprentissage, mais aussi impliquer sur le terrain une population d’étudiants plus large et plus diversifiée. Les sciences informatiques rencontrent des défis bien connus, avec une sous-représentation des femmes et des minorités à toutes les étapes de la chaîne (Margolis, 2013), le problème s’étant nettement aggravé au cours des dernières décennies, même si toutes les disciplines ne sont pas touchées (National Science Foundation, 2013).

4Nous partons du principe que si une approche de type STEAM de l’enseignement, dans le cadre d’une initiation à l’informatique, est authentique (Shaffer et Resnick, 1999) et pertinente culturellement dans les domaines conjoints de l’informatique et de la musique, elle peut attirer une population d’étudiants plus diversifiée vers l’informatique. À titre d’exemple, considérez un exercice de programmation basique classique, tel que la traduction de mots anglais en Pig-Latin, un jeu d’enfants dans lequel les lettres sont déplacées du début à la fin de chaque mot (Codecademy, 2016). Cet exercice comporte des opérations sur des chaînes de caractères telles que le découpage et la concaténation. Cependant, il lui manque des possibilités créatives (c’est-à-dire que toutes les solutions correctes font exactement la même chose) et il n’est pas authentique (c’est un jeu de mots abstrait sans réelle pertinence culturelle ou de lien avec l’industrie et les carrières professionnelles). Maintenant, considérez un exercice similaire réalisé avec EarSketch dans lequel on demande aux élèves de créer des rythmes de batterie séquencés en pas à pas en définissant des chaînes avec des caractères spéciaux, puis en répétant et en faisant varier ces rythmes par des opérations sur ces chaînes et des boucles. L’exercice peut être extrêmement créatif et expressif, car chaque élève crée et partage différentes musiques en utilisant les mêmes techniques. Il offre également une connexion claire avec le séquençage pas à pas et les techniques de boîtes à rythmes utilisées dans la production musicale populaire.

1.2. Faciliter l’accès à l’enseignement des technologies pour la musique

5Traditionnellement, des cours d’introduction aux technologies pour la musique ont déjà été donnés en petites sections, avec un accès en effectifs limités à des installations partagées, telles que des studios MIDI ou d’enregistrement, qui sont nécessaires pour réaliser ces projets d’enseignements. Dans un lycée de la région d’Atlanta auquel nous sommes associés, environ 1 000 élèves ont voulu suivre un cours de technologie musicale, alors qu’il n’y avait de la place que pour 30 élèves dans le laboratoire. Dans notre propre université, Georgia Tech, nos cours d’introduction aux technologies pour la musique sont souvent limités à 15 étudiants, et ils sont remplis seulement quelques minutes après l’ouverture des inscriptions.

6Comme le studio traditionnel s’est de plus en plus virtualisé ces dernières années, de nombreuses écoles ont commencé à se diriger vers des cours d’initiation plus larges, des sortes de conférences dans lesquelles les étudiants utilisent leurs propres ordinateurs portables avec des logiciels libres et open source plutôt que de travailler dans des studios dédiés avec des plates-formes commerciales haut de gamme. En tant que plate-forme d’apprentissage gratuite et basée sur le Web, EarSketch s’intègre facilement dans ces cours. Parce qu’il intègre le codage et la composition algorithmique dans un paradigme de station de travail audio numérique (DAW), il fournit un moyen efficace de lier des techniques de production musicale basées sur un environnement utilisateur graphique à des approches de création musicale par la programmation.

7Cependant, de grandes classes avec les ordinateurs portables des étudiants ne suffisent pas pour répondre à la demande en enseignements des technologies musicales. Les petits effectifs en professeurs de technologie musicale dans la plupart des écoles est un autre facteur limitant. EarSketch, par conséquent, est également conçu pour être utilisé dans des cours d’introduction à l’informatique qui n’incluraient normalement aucun composant musical. Cela fournit un moyen d’apprentissage supplémentaire avec lequel les étudiants peuvent apprendre à la fois la musique et les technologies musicales.

1.3. Évangéliser la création musicale utilisant les technologies

8La musique est progressivement devenue une marchandise faite pour être entendue plutôt qu’une expérience créative à laquelle on participe. Les données récentes de la fondation National Endowment for the Arts, aux États-Unis, montrent que seulement un faible pourcentage d’adultes américains s’engage dans des activités musicales, même une fois par an, alors qu’un pourcentage beaucoup plus élevé écoute de la musique enregistrée ou en direct (Iyengar, 2013). De par son concept, EarSketch n’impose pas de pré requis musical et ne demande pas aux étudiants de savoir lire la notation musicale occidentale ni de jouer d’un instrument. Il initie les étudiants à des concepts de base, comme la forme musicale, le rythme, la mesure, le tempo et la texture, mais aborde surtout la composition musicale par l’utilisation des boucles audio plutôt que par des événements musicaux individuels. De cette façon, il permet d’offrir à des étudiants, qui ne sont généralement que des consommateurs de musique, une expérience de création musicale.

9En s’appuyant sur ces motivations, ce texte décrit en détail la conception et le déploiement de l’environnement et du programme d’apprentissage d’EarSketch, ainsi que certains résultats clés provenant des essais pilotes pour la recherche.

2. Travaux apparentés

10EarSketch s’inspire de nombreux environnements pédagogiques qui ont combiné l’informatique et la musique pour faciliter l’enseignement dans les deux domaines à travers une approche algorithmique. Par exemple, MediaComp (Guzdial, 2003 enseigne une introduction à la programmation en Python en partie en enseignant aux étudiants comment mettre en œuvre des effets audio simples. Sonic Pi (Aaron et Blackwell, 2013) se concentre sur le codage en direct (live coding) sur un périphérique informatique intégré pour la synthèse sonore et la génération de musique symbolique. Performamitics (Heines et al., 2009) rassemble des étudiants en informatique et en musique pour leur permettre de créer des instruments de musique interactifs à travers des paradigmes de programmation visuelle. Enfin JythonMusic (Manaris et Brown, 2014) se concentre sur la génération algorithmique de partitions symboliques et sur la communication en temps réel avec d’autres logiciels et périphériques.

11En plus de ces environnements de programmation spécialisés et de quelques autres, de nombreux langages populaires en informatique musicale, tels que Max (Puckette, 1991), ChucK (Wang et al., 2015), SuperCollider (McCartney, 2002) et Faust (Orlarey et al., 2004), sont omniprésents dans l’enseignement des technologies musicales en cursus universitaires. En outre, de nombreux environnements de programmation conçus spécifiquement pour l’enseignement de l’informatique, tels que Scratch (Resnick et al., 2009) et PencilCode (Bau et al., 2015), incluent des fonctionnalités pour l’enregistrement et la lecture de sons ainsi que pour la génération de données en notes MIDI.

12EarSketch est différent de ces environnements de trois manières significatives qui tirent parti des motivations principales discutées dans la section précédente. Tout d’abord, EarSketch ne repose pas sur la connaissance des représentations symboliques de la musique (par exemple les numéros de notes MIDI ou les noms de notes), ni sur la connaissance de la synthèse sonore ou des techniques de traitement du signal (par exemple les unités génératrices ou la manipulation au niveau des échantillons).

13En deuxième lieu, EarSketch existe principalement selon le paradigme (et l’interface) d’une station de travail audio numérique. Contrairement à Max for Live (Manzo et Kuhn, 2015), l’intégration ne se fait principalement pas par des effets et des plugins, mais plutôt par des opérations de programmation portant directement sur la barre du temps de la station de travail audio multipistes. De cette façon, EarSketch est un proche descendant de l’API ReaScript Python qu’on trouve dans la DAW Reaper (Frankel, 2005).

14Troisièmement, l’objectif d’EarSketch est de donner la possibilité aux utilisateurs de créer rapidement des chansons complètes sans compétences musicales, ni prérequis informatiques. Cette faible contrainte d’accès, combinée à des modèles conceptuels simples permettant de créer rapidement des structures musicales hiérarchisées, est destinée à susciter un engouement immédiat pour la musique et pour la programmation chez notre public cible, jeune, novice et diversifié.

3. L’environnement pédagogique

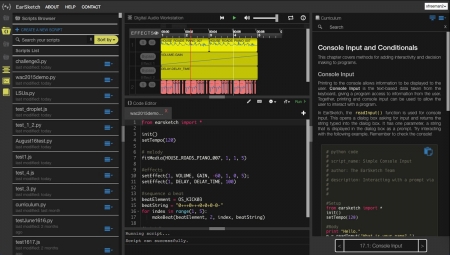

15EarSketch (Figure 1) est un environnement gratuit basé sur le Web qui intègre plusieurs composants dans une fenêtre unique d’un navigateur (Mahadevan et al., 2015). Son apparence, inspiré par des travaux connexes et les trois motivations principales décrites ci-dessus, est guidée par cinq principes fondamentaux : a) encourager l’expression créative et personnelle (c’est-à-dire la création de la musique que les étudiants veulent partager) ; b) se connecter à des outils et des paradigmes omniprésents dans l’industrie de la musique (par exemple, les stations de travail audio numériques) et l’industrie informatique (par exemple, les langages de programmation les plus répandus) ; c) être accessible aux débutants sans expérience préalable en informatique ni en musique ; d) utiliser des objectifs musicaux pour motiver l’apprentissage de nouveaux concepts informatiques ; et e) adapter le programme pédagogique avec les standards existants dans les enseignements en informatique.

Figure 1. Une capture d’écran de l’environnement d’apprentissage en ligne EarSketch

Source : auteurs

16Dans cette section, nous décrivons les principaux composants d’EarSketch : l’environnement de programmation, la station de travail audio numérique (DAW), la bibliothèque de boucles et le programme pédagogique.

3.1. L’environnement de programmation

17Dans l’éditeur de code d’EarSketch, les élèves écrivent du code en Python ou JavaScript, en utilisant soit un éditeur de texte, soit un éditeur de code visuel basé sur des blocs (Bau, 2015). Indépendamment du langage ou de l’éditeur choisi, ils utilisent la même interface de programmation d’application (API) pour écrire de la musique.

18La figure 2 montre un programme EarSketch simple. fitMedia()place un clip audio sur une piste donnée avec une date de début et une date de fin, mettant en boucle ou coupant le clip si nécessaire pour remplir la durée spécifiée. makeBeat() produit une séquence en pas à pas construisant un rythme, chaque caractère de la chaîne représentant une double croche : un « 0 » joue un fichier son à partir de son début, un autre chiffre lit des fichiers audio alternatifs en fonction d’indices stockés dans une liste, un « + » prolonge le fichier son, et un « - » fait un silence. setEffect() ajoute un effet sur une piste (ou sur la piste master), avec des paramètres optionnels pour spécifier les paramètres de l’effet et pour définir une enveloppe pour ces paramètres.

19La figure 3 montre un exemple plus complexe qui imite la pratique du hoquet (c’est-à-dire une alternance rapide de voix) pour créer une piste de batterie hybride à partir de deux sources audio. Pour chaque double croche au cours du temps, on calcule l’amplitude RMS de chaque piste. Le niveau de la piste la plus forte est alors réglé sur 0 dB pour cette double croche, et le niveau de la piste plus silencieuse sur -60 dB. Au-delà de ces exemples, des fonctions API supplémentaires offrent des méthodes alternatives pour le placement des fichiers audio et implémentent diverses fonctions telles que les entrées de console et de fichier et la manipulation de chaînes de caractères.

20Par défaut, EarSketch fonctionne en mode groupé (batch). Le code est interprété en appuyant sur le bouton « exécuter » (run) pour créer la musique. Il ne fonctionne pas de façon interactive pendant que la musique joue. Cette approche suit une méthodologie de production musicale axée davantage sur la création d’une piste fixée que sur la performance en direct. Cependant, EarSketch prend en charge la programmation en direct (live coding) (Freeman et Magerko, 2016). Les utilisateurs peuvent écrire et exécuter du code pendant que l’audio est en cours de lecture et la lecture audio se met à jour de manière transparente.

Figure 2. Un exemple de script EarSketch Python qui place un clip audio sur la piste 1, ajoute une automatisation sur des effets de volume à la piste 1 et place une pulsation séquencée en pas à pas sur la piste 2

from earsketch import *

init()

setTempo(120)

fitMedia(HOUSE_ROADS_PIANO_007, 1, 1, 3)

setEffect(1, VOLUME, GAIN, -60, 1, 0, 3)

beatElement = OS_LOWTOM01

beatString = "0+++0+++0+0+0+0+"

for index in range(1,3):

makeBeat(beatElement,2,index,beatString)

finish()

Figure 3. Un exemple algorithmique EarSketch dans lequel les états « mutés » de deux pistes alternent à chaque double croche en fonction de celle qui a l’amplitude la plus forte

from earsketch import *

init()

setTempo(120)

sound1 = ELECTRO_DRUM_MAIN_BEAT_001

sound2 = ELECTRO_DRUM_MAIN_BEAT_002

analysisMethod = RMS_AMPLITUDE

hop = 0.0625 # analyze 1/16th note chunks

start = 1

end = 3.0

fitMedia(sound1, 1, start, end)

fitMedia(sound2, 2, start, end)

position = 1

while (position < end):

feature1 = analyzeTrackForTime(1,

analysisMethod, position,

position + hop)

feature2 = analyzeTrackForTime(2,

analysisMethod, position,

position + hop)

if (feature1 > feature2):

setEffect(1, VOLUME, GAIN, 0,

position, 0, position + hop)

setEffect(2, VOLUME, GAIN, -60,

position, -60, position + hop)

else:

setEffect(1, VOLUME, GAIN, -60,

position, -60, position + hop)

setEffect(2, VOLUME, GAIN, 0,

position, 0, position + hop)

position = position + hop

finish()

3.2. Station de travail audio numérique (DAW)

21Le panneau de la station de travail audio numérique dans EarSketch affiche la sortie visuelle de l’exécution du code dans un format multipiste standard. Ce n’est pas une DAW entièrement fonctionnelle dans le sens où les étudiants ne peuvent pas ajouter, modifier ou supprimer des clips audio ou des effets ; cela doit se faire par programmation. Les étudiants peuvent naviguer dans leur projet en utilisant les contrôles de transport, en mettant les pistes en solo/mute et en activant/coupant les effets. Ils peuvent également exporter leur projet en tant que mixage stéréo (WAV, MP3 ou Soundcloud) ou en un projet multipiste pour continuer à l’éditer dans un logiciel DAW conventionnel.

3.3. La librairie de boucles

22EarSketch comprend environ 4 000 boucles dans une vingtaine de genres populaires accessibles via une barre latérale de navigation à travers les sons. Ils ont été créés pour EarSketch par Richard Devine, musicien électronique expérimental et concepteur de son, et par Young Guru, un ingénieur du son et DJ plus connu pour son travail avec Jay-Z. Le volet du navigateur sonore imite la fonctionnalité des panneaux d’interface similaires dans les DAW, permettant aux utilisateurs de rechercher et filtrer les sons par artiste, par genre et par instrument. Les sons sont regroupés dans des collections qui contiennent des boucles conçues pour aller bien ensemble. Les utilisateurs peuvent également télécharger leurs propres sons à partir de leur ordinateur ou enregistrer rapidement de nouveaux sons directement dans EarSketch.

23Chaque son dans la bibliothèque est identifié par une constante unique. Pour utiliser les sons dans EarSketch, les utilisateurs collent les constantes dans l’éditeur de code comme arguments de la fonction. EarSketch émet automatiquement des boucles pour correspondre au tempo global du projet.

3.4. Le programme pédagogique (Curriculum)

24Le programme EarSketch est destiné à être utilisé dans des cours d’introduction à l’informatique et de technologies musicales. Il est spécifiquement aligné sur les AP Computer Science Principles (Astrachan et Briggs, 2012), une norme émergente pour les programmes pédagogiques aux États-Unis concernant les cours de science informatique au lycée (pour les adolescents). Le programme EarSketch couvre des sujets d’informatique tels que les types de données, les variables, les fonctions, les listes, les boucles, la logique booléenne, les structures conditionnelles et les chaînes de caractères ainsi que les concepts en musique et en technologies pour la musique tels que les bases des DAW, la forme musicale, le rythme, la mesure, le tempo et la texture.

25Une barre latérale dans EarSketch affiche des documents semblables à des manuels scolaires pour les étudiants, à utiliser pour un apprentissage personnel et comme référence : cela inclut du texte, des exemples de code opérationnels, des démonstrations vidéo, des questions de quiz et des diapositives. Les enseignants en classe peuvent accéder à un matériel pédagogique comprenant des plans de cours, des documents, des projets et des évaluations quotidiennes.

26Chaque été, depuis 2014, l’équipe EarSketch organise des ateliers d’apprentissage professionnel pour les enseignants intéressés à adopter EarSketch. Ces ateliers enseignent EarSketch et les fondamentaux de l’informatique musicale dont les enseignants ont besoin pour leurs cours, ainsi que des techniques pédagogiques sur des sujets tels que « faciliter la collaboration entre les étudiants », « la discussion autour des projets étudiants » et « l’aide aux étudiants dans le dépannage du code ».

4. Contextes de déploiement

27EarSketch a été utilisé dans divers contextes pédagogiques, comprenant des cours en informatique et en technologie pour la musique dans les universités et dans les établissements secondaires ; des cours d’été pour les élèves du primaire, du collège et du lycée ; des cours d’introduction à l’informatique en premier cycle universitaire ; et un Massive Open Online Course (MOOC) en technologie musicale enseigné par l’un des auteurs (Freeman) sur Coursera (Freeman, 2015). Depuis que nous avons lancé la version Web d’EarSketch en 2014, plus de 55 000 utilisateurs individuels de plus de 100 pays ont programmé avec EarSketch, enregistrant plus de 47 000 projets sur notre serveur.

5. Résultats des opérations pilotes

5.1. Cours de science informatique dans les lycées d’Atlanta

28Entre 2013 et 2015, nous avons mené plusieurs opérations pilotes sur EarSketch dans des cours d’informatique académiques dans quatre lycées différents d’Atlanta. Pour étudier l’impact d’EarSketch sur les élèves dans ces cours, nous avons utilisé plusieurs méthodes de recherche différentes, comprenant des questionnaires, des évaluations de contenu, des observations, des entrevues et des groupes de discussion. L’évaluation des connaissances, effectuée avant et après le module EarSketch du cours, était une évaluation à choix multiples alignée sur les objectifs d’apprentissage des cours.

29Une enquête sur l’engagement des étudiants, réalisée rétrospectivement, a permis de mesurer les éventuels changements touchant à l’utilisation de l’informatique par les élèves. Cet outil calcule des échelles selon Williams, Wiebe, Yang, & Miller (2003) et selon Knezek & Christensen (1996) mesurant « la compétence en informatique », « le plaisir à pratiquer l’informatique », « la perception de l’importance de l’informatique et de son utilité », « la motivation pour réussir », « l’identité et l’appartenance numérique » comme variables prédictives et « l’intention de continuer dans l’informatique » comme variable de résultat. La littérature autour de la pédagogie STEM2 suggère que ces projets sont essentiels pour augmenter le nombre, actuellement insuffisant, d’étudiants qui travaillent dans les champs STEM (Wiebe et al., 2003). Les versions antérieures de l’outil ont également adopté l’indice Creativity Support (Carroll et al., 2009), mais plus récemment, nous avons développé nos propres outils pour évaluer les perceptions des élèves sur la créativité, en s’appuyant sur des recherches antérieures (Amabile, 1990 ; Mayer, 1999) sur la créativité.

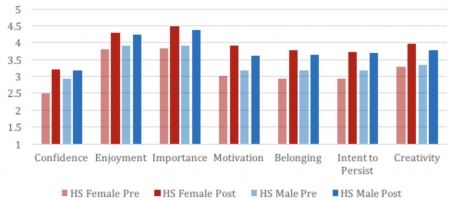

30Résumons à présent les résultats de notre étude pilote de 2013 (Magerko et al., 2016), dans laquelle nous avions comparé les résultats des étudiants EarSketch selon le sexe. L’étude comprenait des étudiants de deux cours : l’un était un cours d’introduction à l’informatique ; l’autre un cours d’introduction aux technologies pour la musique. Les deux comprenaient un module de suivi similaire EarSketch. 97 étudiants ont fourni des données utilisables pour l’ensemble de ces sondages, dont 27 % de femmes et 73 % d’hommes (une répartition typique de ces cours). Les étudiants ne savaient pas qu’ils utiliseraient EarSketch avant l’inscription au cours.

31Les étudiants masculins et féminins ont montré des augmentations statistiquement significatives dans tous les cas de figure, après l’utilisation d’EarSketch (p < 0,01), à l’exception de l’indice de confiance concernant les hommes (p = 0,07). En outre, dans tous les cas de figure les étudiantes ont montré des changements plus importants que les hommes ; ces différences sont importantes (p < 0,05) en termes de confiance, de motivation et d’identité d’appartenance. La figure 4 montre cela graphiquement : dans tous les cas, les étudiantes sont moins engagées que leurs homologues masculins avant d’étudier EarSketch, mais sont plus engagées que les étudiants masculins après avoir étudié EarSketch. Les connaissances sur le contenu des étudiants masculins et féminins ont également considérablement augmenté entre avant et après, mais il n’y avait pas de différences significatives entre les gains des étudiants masculins et féminins dans cette région. Ces résultats sont discutés plus en détail dans Magerko et al. (2016).

Figure 4. Les résultats du sondage avant et après l’enquête portant sur des étudiants masculins et féminins d’une étude pilote EarSketch, 2013, dans un lycée de la région d’Atlanta

L’axe vertical représente les réponses moyennes des étudiants, dont 1 signifie « Fortement en désaccord » et 5 signifie « Totalement d’accord »

32Les groupes de discussion et les éléments de réponses libres dans les enquêtes auprès des élèves suggèrent que les principes fondamentaux de conception sur lesquels est fondé EarSketch jouent un rôle important dans l’engagement des étudiants. Certains étudiants ont souligné l’importance de l’expression et de la créativité personnelles, commentant : « je devais exprimer mes idées et c’était amusant et motivant de voir que je pouvais être bon en informatique » et « j’ai apprécié de faire mes propres morceaux de musique que des gens, y compris moi-même, appréciaient vraiment ». D’autres se sont concentrés sur l’importance du contexte réel : « j’ai aimé apprendre comment la musique peut être créée et comment nous pouvons apprendre et devenir bons dans la réalisation de certaines choses que font maintenant les gens de l’industrie musicale. » Cela semblait influer sur l’intérêt des élèves à poursuivre leurs études, comme l’a démontré ce commentaire d’un participant au groupe de discussion : « cela me donne des idées pour l’université. C’est des choses comme ça que j’aimerais bien faire à l’université et j’aimerais vraiment faire ça dans ma vie. Oui. J’aimerais bien le faire. »

33Ces résultats pilotes suggèrent que EarSketch a un fort potentiel pour motiver les étudiants – et en particulier les étudiantes – à s’engager dans l’informatique musicale à un premier niveau.

5.2. Un MOOC (Massive Open Online Course) sur les technologies pour la musique

34Étant donné que la question des durées de production était une motivation essentielle autour du développement de EarSketch, nous nous sommes également intéressés aux résultats des étudiants aux limites extrêmes de l’échelle : un cours de six semaines non crédité sur un « Aperçu des Technologies pour la Musique » (Survey of Music Technology) sur le site Coursera, l’un des principaux éditeurs de MOOC. Le cours a reflété le contenu des cours d’introduction aux technologies pour la musique à Georgia Tech, présentant les techniques de production musicale avec une station de travail audio numérique (Reaper), la composition algorithmique (à l’aide de EarSketch) et la théorie sous-jacente, l’histoire, l’esthétique et les orientations de recherche du domaine. Le cours consistait en des conférences vidéo, des quiz et des exercices vidéo, des tests hebdomadaires à choix multiples, deux projets créatifs évalués par des pairs et un forum de discussion.

35Le cours a d’abord été proposé à l’automne 2013, puis à nouveau à l’automne 2014 en utilisant un modèle basé sur le groupe. À partir de l’automne 2015, le cours a été adapté sur un nouveau modèle, à la demande de Coursera, dans lequel un nouveau groupe d’étudiants commence chaque mois, les étudiants ayant ainsi plus de souplesse pour adapter les cours à leur propre calendrier. À ce jour, plus de 50 000 étudiants se sont inscrits au cours, même si, comme c’est typique avec les MOOC, seule une petite fraction de ceux qui ont participé plus ou moins activement ont terminé la classe.

36Les MOOC présentent de nombreux défis et limites par rapport aux cours dans les lycées que nous avions étudiés précédemment. Ils attirent des étudiants d’âges, d’antécédents géographiques et d’expériences très variés et qui se sont inscrits pour des raisons très diverses. Ces étudiants suivent le cours avec une interaction minimale avec leurs pairs ou avec leur instructeur. L’environnement d’apprentissage structure fortement les activités d’apprentissage selon des modèles prédéfinis et, bien sûr, toutes ces activités sont en ligne. Malgré ces différences, le cours a présenté plusieurs points communs avec nos cours du secondaire, notamment des projets ouverts qui ont encouragé la créativité et l’expression personnelle ; des connexions claires avec les outils et les paradigmes des industries de la musique et de l’informatique ; l’accessibilité aux débutants sans expérience préalable en musique ou en informatique ; l’utilisation d’objectifs musicaux pour motiver l’apprentissage technique ; et, bien sûr, le même environnement d’apprentissage sur le Web (EarSketch).

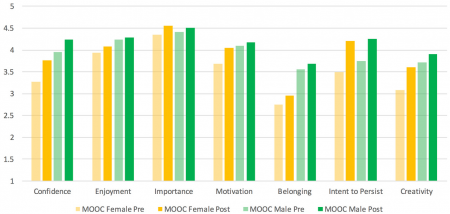

37À l’automne 2014, nous avons demandé aux étudiants du MOOC de compléter le même sondage sur l’engagement des étudiants que celui utilisé dans notre étude du secondaire, dans le but de comparer les résultats afin de mesurer l’effet à l’échelle MOOC (et ses limites correspondantes) sur l’engagement des élèves, en particulier en ce qui concerne le genre. Nous avons limité la participation aux étudiants qui ont complété au moins un projet ou un quiz sur EarSketch. Cent seize étudiants de ce type ont participé à l’étude (99 hommes et 17 femmes). De petits changements ont été apportés aux questions du sondage, relatives à l’intention de persister, puisque certaines des questions originales présumaient que les étudiants n’avaient pas encore fréquenté le collège (en fait, de nombreux étudiants du MOOC avaient déjà des diplômes universitaires).

38Les résultats, présentés dans la figure 5, montrent des gains entre avant et après le module EarSketch, tant pour les hommes que pour les femmes. Les gains sont statistiquement significatifs (p < 0,001) dans tous les cas de figure, excepté en ce qui concerne la motivation pour les hommes (p = 0,002) et la motivation (p = 0,002), la confiance (p = 0,018), l’identité (p = 0,007), l’intention de persister (p = 0,001) et la créativité (p = 0,001) pour les femmes. À l’instar de l’étude dans le secondaire, les étudiantes commencent le cours en étant moins engagées dans le calcul que leurs homologues masculins. À l’instar de l’étude du secondaire, les gains des élèves de sexe féminin, consécutivement à la formation, sont supérieurs à ceux des étudiants masculins dans tous les cas, et ce de façon significative (p = 0,03) pour un test « t-test » de comparaison de genre sur le concept de créativité. Contrairement à l’étude dans le secondaire, ces gains plus importants pour les étudiantes ne suffisent pas à faire participer les femmes à parité avec l’engagement masculin à la fin du cours. Les étudiantes sont plus proches des niveaux d’engagement de leurs homologues masculins, mais dans tous les cas sauf un (importance) n’ont pas compensé toutes les disparités signalées avant la formation.

Figure 5. Les résultats du sondage, auprès d’étudiants masculins et féminins, avant et après les enseignements d’un MOOC de 2014

L’axe vertical représente les réponses moyennes des élèves ; 1 signifie « Fortement en désaccord » et 5 signifie « Totalement d’accord »

39Ces résultats suggèrent que EarSketch, même à l’échelle d’un MOOC et avec les limitations inhérentes à ce type d’enseignement, a toujours un effet positif significatif sur l’engagement pour les étudiants de sexes masculins et féminins. Ils suggèrent également que EarSketch a un impact encore plus important sur l’engagement pour les femmes que pour les hommes (surtout en ce qui concerne la créativité), ce qui réduit en partie à la fin du cours, mais pas totalement, les disparités initiales d’engagement entre les deux sexes. Ces résultats doivent être relativisés par la petite taille de l’échantillon, en particulier pour les étudiantes. Malgré ces résultats prometteurs en ce qui concerne l’engagement des étudiantes, le MOOC (et les MOOC en général) se heurte au déséquilibre entre les sexes : seulement 17 % des étudiants inscrits à l’Enquête sur la technologie de la musique MOOC sont des femmes. Pour initier un changement durable sur le terrain, nous devons trouver de meilleures façons de recruter des étudiantes pour les inscrire au cours, pas seulement pour les engager efficacement une fois qu’elles s’inscrivent.

6. Conclusion

40L’engouement pour EarSketch augmente rapidement et nous intensifions actuellement nos efforts de recherche pour comprendre comment EarSketch influe sur l’engagement et la connaissance des contenus des élèves dans des contextes scolaires et culturels plus diversifiés. Au cours des deux prochaines années, nous élargirons nos recherches pour étudier l’impact d’EarSketch dans environ 30 cours d’informatique fondamentale dispensés dans des lycées en Géorgie, en utilisant des évaluations de connaissances de contenu, des enquêtes de participation, des observations, des entrevues et des groupes de discussion pour comprendre comment EarSketch influe sur les élèves et comment nous pouvons continuer à l’améliorer. Dans le cadre de cette étude, nous utilisons également une conception quasi expérimentale, comparant les salles de classe utilisant EarSketch aux salles de classe utilisant d’autres environnements d’apprentissage. Nous utilisons également des techniques de modélisation de systèmes complexes (Llewellyn et al., 2013) pour modéliser les ensembles complexes d’attributs et de relations qui sous-tendent les interventions d’apprentissage.

41En même temps, nous ajoutons à EarSketch de nouvelles modalités et de nouveaux contextes pour l’apprentissage. Par exemple, nous développons actuellement une interface de table collaborative adaptée aux installations des musées et aux événements de proximité. Nous avons récemment ajouté un support pour P5 (McCarthy, 2016) dans EarSketch pour soutenir la génération d’éléments visuels aux côtés de la musique et explorons les moyens de connecter EarSketch à des systèmes informatiques physiques tels que les Moog Werkstatt (Howe, 2014) et les Lilypad Arduino (Buechley et al., 2008).

42Indépendamment des modalités et du contexte, nos objectifs restent les mêmes : engager une population large et diversifiée dans la production musicale et la programmation informatique, et ce faisant, susciter son intérêt pour ces activités, afin qu’elle persiste et continue à se développer au-delà d’une simple intervention d’apprentissage.

Notes

1 Une approche de type STEAM (Science, Technology, Engineering, the Arts and Mathematics) est une approche pédagogique qui utilise les Sciences, les Technologies, l’Ingénierie, les Arts et les Mathématiques comme points d’entrée pour guider les recherches et les travaux des étudiants à travers le dialogue et une pensée critique. En définitive, cette démarche forme des étudiants qui prennent des risques réfléchis, s'engagent dans des démarches expérimentales, s’intéressent à la résolution de problèmes, et savent travailler en collaboration, autour de processus créatifs.

2 Science, Technology, Engineering and Mathematics.